本文提出的是用 deep learning 來訓練出圖片特徵點的方法。

此方法的精神是先將 feature detector 與 geometric transformation 建立 bijective mapping 的關係,因此能將訓練的空間從 feature detector 轉化至 geometric transformation 的空間上。

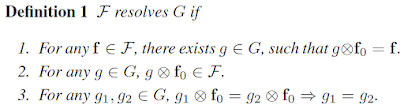

Feature detector 與 Geometric transformation 的關係

上圖即是將 feature detector 與 geometric transformation 的 bijective mapping 關係建立起來的前提。運算子 \(\otimes \) 為將一個 feature \(\mathbf{f}\) 利用 g 轉換成另一個 feature 的過程。

Loss function

下圖為本文的 loss function:

第一部分的意思是針對一個 standard patch(也就是最 discriminative 的 local patch),利用類神經網路學習一個轉換 \(\phi\),由於這是個 standard patch,因此在經由 \(g_i\) 轉換後再做此轉換與先做此轉換再利用 \(g_i\) 來變換的結果應該一致。(註:此步驟的意思是以特徵點為中心的 standard patch 上,無論怎麼做變換結果應該都是等價的。)

此 loss function 的第二部分為 standard patch 本身的特性,也就是 standard patch 經由 \(\phi\) 變換後應該要得到此變換空間的 identity \(e\),可以想成由於已經是 standard patch,因此它對應的變換必須為變換空間的 identity。

計算 feature 的過程

在訓練好模型 \(\phi\) 以後即可用上圖 (c) 的方法來得到特徵點:無論怎麼取 local patch,經由 \(g^{-1}\) 轉換後會變成 standard patch,接著可以用累積附近 patch 的方法取得最後的特徵點。

參考資料

[1] Learning Discriminative and Transformation Covariant Local Feature Detectors

沒有留言:

張貼留言